Datenschutz und KI in der Praxis – Anonymisierungs Tools und Schulungen

ChatGPT und andere webbasierte generative Künstliche Intelligenzen haben die Welt im Sturm erobert. Unternehmen setzen KI-Tools ein, um Prozesse zu optimieren, die Produktivität zu steigern und die Kundenzufriedenheit zu verbessern. Aber wie vertrauenswürdig sind große Sprachmodelle im Umgang mit Unternehmensdaten? Datensicherheit ist bei ChatGPT und anderen KI-Tools ein signifikantes Thema. Wie können die Tools genutzt werden und gleichzeitig die Privatsphäre und den Datenschutz wahren?

*Wir nutzen ChatGPT stellvertretend für alle webbasierten generativen künstlichen Intelligenzen

Bedenken bezüglich des Datenschutzes bei KI-Tools?

ChatGPT und andere KI-Tools bergen neben ihren Möglichkeiten auch Risiken. Wie schon das Peter-Parker-Prinzip besagt: „Mit großer Macht kommt große Verantwortung.“ Die intensivere Nutzung dieser mächtigen Tools wirft berechtigte Fragen zum Datenschutz auf.

Große Unternehmen wie Walmart, Amazon und Microsoft, aber auch OpenAI selbst, warnen vor der Eingabe sensibler Daten in ChatGPT. Sie befürchten, dass Interna in die falschen Hände geraten und dadurch Schaden entstehen könnte. Auch auf Regierungsebene denken einige Länder über ein Verbot nach.

Datenschutz Risiko: Personenbezogene und sensible Daten

Eines der größten Datenschutz-Risiken bei ChatGPT ist die mögliche Weitergabe personenbezogener Daten.

Es mag verlockend erscheinen, Anfragen von Kunden einfach an KI-Tools weiterzuleiten, um in Sekundenschnelle personalisierte Antworten zu erhalten.

Trotzdem können persönliche Informationen wie Namen, Adressen oder Kontodaten preisgegeben werden, ohne dass Nutzer dies beabsichtigen. Derartige sensible Angaben gehören nicht in die Verarbeitung von KI-Tool, auf die Dritte potenziell zugreifen können.

VORSICHT!

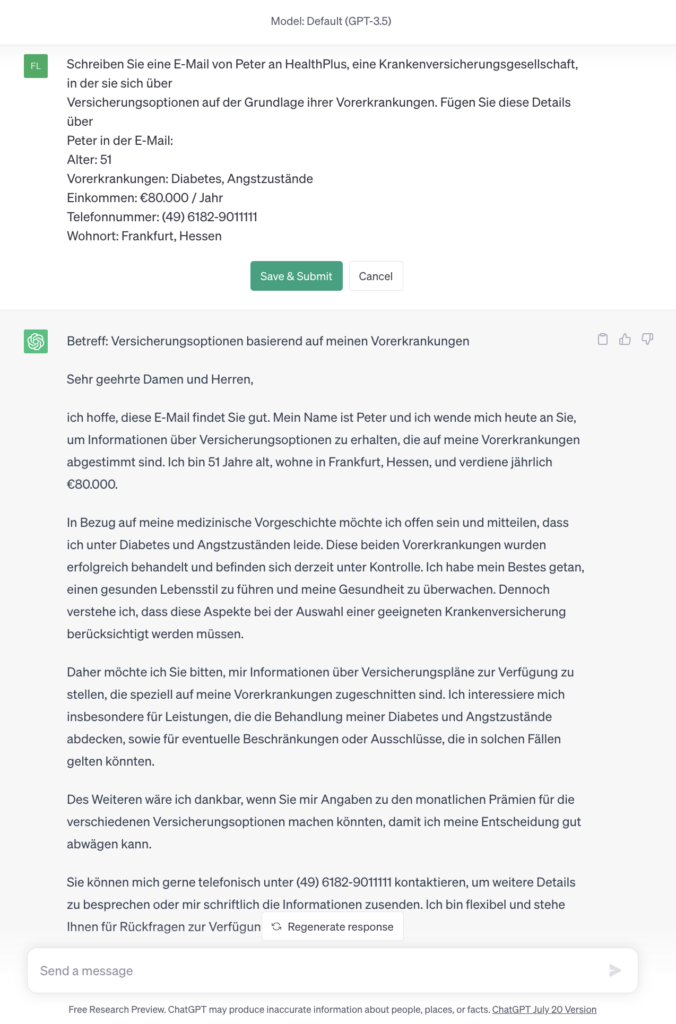

ChatGPT und andere KI-Tools sind nicht von Gesetzen wie der DSGVO, HIPAA, PCI DSS oder CCPA ausgenommen. Die DSGVO fordert beispielsweise, dass Unternehmen die Zustimmung bzw. rechtliche Grundlage für alle Verwendungen personenbezogener Daten ihrer Benutzer benötigen und auch deren Löschungsanträgen nachkommen müssen. Durch die Weitergabe personenbezogener Informationen an Drittanbieter verlieren diese Unternehmen die Kontrolle darüber, wie diese Daten gespeichert und verwendet werden, und setzen sich damit ernsthaften Risiken von Datenschutzverletzungen aus, wie Sie in dem folgenden Chat-Verlauf eines Nutzers in ChatGPT sehen können:

Datenschutz Problem: Datenminimierung und KI

Ein weiterer Konflikt steht mit folgenden Grundsatz der DSGVO: der Datenminimierung. KI-Tools benötigen normalerweise große Mengen an Daten, um ihr Training abzuschließen und genaue Vorhersagen zu machen. Je mehr Daten zur Verfügung stehen, desto besser können KI-Tools Muster erkennen und komplexe Aufgaben bewältigen. Daher besteht die Versuchung, so viele Daten wie möglich zu sammeln und zu verwenden. Zusätzlich dazu kann das Fehlen von geeigneten Tools und Methoden zur Datenminimierung eine Hürde sein.

Es erfordert spezialisierte Techniken, um irrelevante oder sensitive Informationen aus den Datensätzen zu entfernen, während gleichzeitig die nützlichen Informationen erhalten bleiben. Die Entwicklung und Implementierung solcher Methoden erfordert nicht nur Expertenwissen, sondern auch Ressourcen und Zeit.

Datenschutzkonforme Nutzung ChatGPT und KI-Tools

So nutzen Sie ChatGPT und KI-Tools sicher

Um die rechtskonforme und datenschutzfreundliche Nutzung von ChatGPT in Unternehmen zu gewährleisten, empfehlen sich folgende Richtlinien:

Mitarbeiterschulung

Dies mag wie ein offensichtlicher Schritt erscheinen, aber viele Unternehmen versäumen es, ihren Mitarbeitern eine angemessene Schulung zum Datenschutz und KI (Link zu unserer Schulung) zu geben. Jede Person, die mit Benutzerdaten umgeht, sollte eine formale Schulung zum sicheren und rechtlichen Umgang mit diesen Daten erhalten – und insbesondere über die Datenschutzbedenken und Datenschutz Risiken bei ChatGPT informiert werden. (Verweis auf unsere Klickschulung)

Einholen der Zustimmung der Kunden

Unternehmen müssen zwingend die Zustimmung der Kunden einholen, bevor sie deren personenbezogene Informationen sammeln und mit ChatGPT verarbeiten. Sie müssen den Kunden auch klar machen, wie ihre Daten verwendet werden, und sicherstellen, dass sie die Möglichkeit haben, der Datenverarbeitung zu widersprechen.

Anonymisierung und Pseudonymisierung

In diesem Kontext sind Anonymisierung und Pseudonymisierung zwei vielversprechende Lösungsansätze, um die Datenschutzanforderungen zu erfüllen.

Anonymisierung und KI

Die Anonymisierung bezieht sich auf den Prozess der Entfernung oder Modifizierung von Informationen, die dazu führen würden, dass eine Person identifiziert werden kann. Bei KI-Systemen bedeutet dies, dass personenbezogene Daten so bearbeitet werden, dass keine Rückschlüsse auf die Identität einer Person möglich sind. Diese Technik bietet eine effektive Möglichkeit, sensible Daten zu schützen, ohne die gesammelten Informationen vollständig zu eliminieren.

Pseudonymisierung und KI

Ein weiterer Lösungsansatz ist die Pseudonymisierung, bei der personenbezogene Daten durch einen eindeutigen Identifikator, das Pseudonym, ersetzt werden. Mit dieser Methode können personenbezogene Daten weiterhin verarbeitet und analysiert werden, während gleichzeitig der Schutz der Privatsphäre gewährleistet ist. Die Verwendung von Pseudonymen ermöglicht es, relevante Informationen zu erhalten und gleichzeitig sensible Daten zu anonymisieren.

Sowohl die Anonymisierung als auch die Pseudonymisierung bieten Vorteile für den Schutz der Privatsphäre und ermöglichen gleichzeitig die Nutzung von Daten für KI-Tools. Durch den Einsatz dieser Techniken können Unternehmen den Datenschutz gewährleisten, indem sie relevante Informationen anonymisieren oder pseudonymisieren, während sie gleichzeitig die Leistungsfähigkeit ihrer KI-Prozesse aufrechterhalten.

Es ist jedoch wichtig zu beachten, dass Anonymisierung und Pseudonymisierung keine endgültigen Lösungen sind. Es besteht immer noch das Risiko, dass personenbezogene Informationen durch Rückführungen oder andere Mittel identifiziert werden können. Daher müssen Unternehmen zusätzliche Maßnahmen ergreifen, um den Schutz der Daten zu gewährleisten, wie zum Beispiel eine sichere Speicherung der Pseudonyme oder die Nutzung von verschlüsselten Datenübertragungen.

Praktische Umsetzung von Anonymisierung und Pseudonymisierung

Die Anonymisierung und Pseudonymisierung von Daten sind essenzielle Maßnahmen, um den Datenschutz bei der Verwendung von KI-Tools zu gewährleisten. In diesem Blogabschnitt werfen wir einen Blick auf die praktische Umsetzung dieser Techniken und wie sie dabei helfen, sensible Informationen zu schützen.

Identifikation sensibler Daten: Der erste Schritt besteht darin, alle personenbezogenen Daten zu identifizieren, die in den KI-Tools verwendet werden. Dies können Namen, Adressen, Telefonnummern oder andere identifizierende Informationen sein. Es ist wichtig, eine genaue Liste der sensiblen Daten zu erstellen, um sicherzustellen, dass jede Information entsprechend anonymisiert oder pseudonymisiert wird.

Auswahl der Anonymisierungsmethoden: Es gibt verschiedene Methoden, um die Anonymisierung und Pseudonymisierung durchzuführen. Dies kann die Entfernung von Namen oder anderen identifizierenden Informationen, die Veränderung von Datenwerten oder die Verwendung von Pseudonymen beinhalten. Die Auswahl der geeigneten Methoden hängt von den individuellen Anforderungen und dem Grad des Datenschutzes ab.

Durchführung der Anonymisierung/Pseudonymisierung: Sobald die sensiblen Daten identifiziert und die Methoden ausgewählt wurden, kann die eigentliche Anonymisierung oder Pseudonymisierung erfolgen. Dies kann automatisiert oder manuell durchgeführt werden, je nach Menge der zu verarbeitenden Daten. Es ist wichtig sicherzustellen, dass der Prozess gründlich und präzise durchgeführt wird, um sicherzustellen, dass die Daten ordnungsgemäß geschützt sind und gleichzeitig die KI-Funktionalität erhalten bleibt.

Überprüfung der Ergebnisse: Nach der Anonymisierung oder Pseudonymisierung ist es wichtig, die Ergebnisse zu überprüfen, um sicherzustellen, dass die Daten tatsächlich anonymisiert oder pseudonymisiert wurden. Dies kann durch Überprüfung der Daten auf Identifizierbarkeit oder durch Verwendung spezifischer Metriken zur Bewertung der Anonymität erfolgen. Es ist wichtig, dass die Daten so modifiziert sind, dass keine Rückschlüsse auf die Identität von Personen möglich sind.

Sicherheit der Pseudonyme: Wenn Pseudonyme verwendet werden, ist es wichtig, sicherzustellen, dass diese angemessen gesichert sind. Dies kann durch den Einsatz von sicheren Verschlüsselungsverfahren oder durch Verwendung von Hash-Funktionen erfolgen. Die Pseudonyme sollten niemals rückführbar sein, um sicherzustellen, dass die Privatsphäre der betroffenen Personen geschützt ist.

Automatisierte Anonymisierung bei dem Einsatz von KI-Tools

Wir haben festgestellt, dass ChatGPT ist ein wertvolles Tool für Unternehmen ist, die ihre Kundeninteraktionen verbessern und ihre Prozesse optimieren möchten. Doch in Anbetracht von Datenverstößen und vollständigen Länderverboten waren Datenschutzbedenken bei ChatGPT für alle Benutzer ein Anliegen, insbesondere in Bezug auf die Weitergabe personenbezogener Informationen. Eine bequeme Lösung, die Sicherheit vor Abmahnungen und Datenschutzverstößen bietet, ist der Einsatz von Anonymisierungs-Tools.

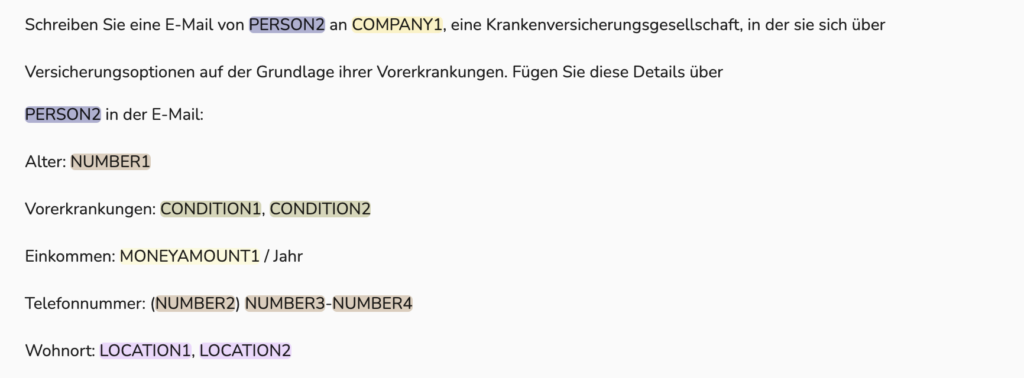

Das Anonymisierungs-Tool von intercompliance bietet eine neue Funktion, die sensible Daten aus ChatGPT und anderen KI-Tools (muss per API anbindbar sein) entfernt. Das Tool nutzt moderne Generative AI-basierte Named Entity Recognition-Modelle und reguläre Ausdrücke, um sensible Informationen wie Namen, E-Mail-Adressen, Kreditkartennummern, Telefonnummern, Geburtsdaten, Standortdaten, Gesundheitsdaten, etc. von ChatGPT zu filtern.

Mit dem Anonymisierung-Tool werden nur die nötigen Informationen mit dem Chatbot geteilt. Es anonymisiert automatisch über 50 Arten von personenbezogenen Informationen, bevor sie an ChatGPT gesendet werden. Die Antwort wird dann erneut identifiziert, damit der Endbenutzer das gleiche Nutzungserlebnis hat, ohne dass personenbezogene Informationen gefährdet werden. Entitäten können ein- oder ausgeschaltet werden, um genügend Kontext an OpenAI zu senden, um eine nützliche Antwort zu erhalten.

Wenn wir das gleiche Beispiel wie zuvor mit unserer Anonymisierungs-Lösung senden, sieht das Ergebnis so aus:

Die Implementierung von Anonymisierungs Tools wie dem von intercompliance kann Unternehmen dabei helfen, ihre sensiblen Daten zu schützen und die Einhaltung wichtiger Datenschutzbestimmungen wie der DSGVO und des California Consumer Privacy Act (CCPA) sicherzustellen. Unternehmen können die Vorteile der neuen Technologien nutzen, um ihr Geschäftswachstum voranzutreiben, während sie gleichzeitig ihre sensibelsten Daten schützen.

Fazit

Um die Einhaltung der geltenden Datenschutz zu gewährleisten und die Privatsphäre der Kunden zu schützen, sollten Unternehmen ihren Mitarbeitern eine angemessene Schulung zum Datenschutz geben, die Zustimmung der Kunden einholen, wenn relevant, und alle möglichen personenbezogenen Informationen anonymisieren, bevor sie durch ChatGPT verarbeitet werden.

Anonymisierung-Tools wie oben vorgestellt bieten eine Lösung für diese Bedenken, indem sie personenbezogene Informationen automatisch vor dem Senden an ChatGPT anonymisieren. Dadurch können Unternehmen KI-Tools nutzen, ohne sich Sorgen um Datenschutzprobleme machen zu müssen.

Durch die Kombination interner Best Practices und die Verwendung von datenschutzorientierten Lösungen können Unternehmen ChatGPT sicher nutzen, um ihre Geschäftstätigkeit zu verbessern und das Kundenerlebnis zu optimieren.

Weitere interessante Beiträge